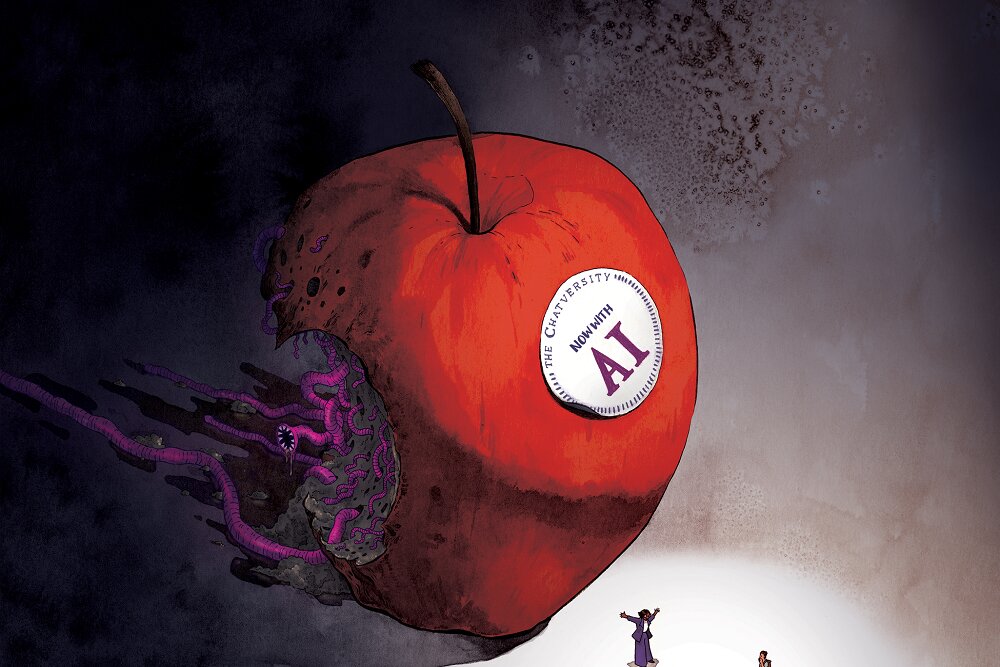

به گزارش ایسنا، رونالد پورسر استاد دانشگاه ایالتی کالیفرنیا در مقالهای در مجله Current Affairs در مورد هوش مصنوعی مولد هشدار داده است که این پدیده نه تنها به ابزاری برای تقلب دانشجویی تبدیل شده بلکه کل ساختار آموزش عالی را بلعیده است. او مینویسد: من پیش از این فکر میکردم که هیاهوی پیرامون هوش مصنوعی فقط در حد هیاهو است. وقتی چت جیپیتی شروع به کار کرد در مورد آن تردیدهایی داشتم. هیاهوی رسانهای، اعلامیههای نفسگیر از یک دوره جدید، همه چیز آشنا به نظر میرسید. من فکر میکردم که مانند هر مد فناوری قبل از آن، از بین خواهد رفت اما اشتباه میکردم. البته نه به آن شکلی که ممکن است فکر کنید.

به نقل از کورنت افرز، در ادامه این مقاله آمده است: ابتدا ترس و واهمه از راه رسید. جلسات هیئت علمی از درگیر ترس شد که حالا چگونه سرقت ادبی را تشخیص خواهیم داد؟ آیا این پایانی بر مقالات دانشگاهی است؟ آیا باید به دفترچه امتحانات تشریحی و امتحانات با مراقب برگردیم؟ همکاران دانشکده بازرگانی من ناگهان طوری رفتار کردند که انگار تقلب تازه اختراع شده است.

سپس، تقریبا یک شبه، نگرانی به ذوق تبدیل شد. همان اساتیدی که پیشبینی نابودی آکادمیک را میکردند، اکنون با هیجان خود را به عنوان «مربیان آماده برای هوش مصنوعی» معرفی میکردند. در سراسر دانشگاه، کارگاههایی مانند «ایجاد مهارتها و دانش هوش مصنوعی در کلاس درس» و «مبانی سواد هوش مصنوعی» مانند قارچ پس از باران از زمین سر بر آوردند. وحشت اولیه در مورد سرقت ادبی جای خود را به پذیرش تسلیمگرایانه داد: اگر نمیتوانید آنها را شکست دهید، به آنها بپیوندید.

این تغییر چهره منحصر به دانشگاه من نبود. سیستم دانشگاه ایالتی کالیفرنیا (CSU)، بزرگترین سیستم دانشگاه دولتی آمریکا با ۲۳ دانشگاه و نزدیک به نیم میلیون دانشجو با تمام قوا وارد عمل شد و همکاری ۱۷ میلیون دلاری با شرکت هوش مصنوعی اوپنایآی را اعلام کرد. سیستم دانشگاه ایالتی کالیفرنیا به اولین سیستم دانشگاهی «قدرتمند با هوش مصنوعی» کشور تبدیل شد و ChatGPT Edu نسخهای با برند دانشگاه که برای مؤسسات آموزشی طراحی شده است را به صورت رایگان به هر دانشجو و کارمند ارائه داد. در بیانیههای مطبوعاتی، از «ابزارهای یادگیری شخصیسازیشده و متمرکز بر آینده» و آمادهسازی دانشجویان برای «اقتصاد مبتنی بر هوش مصنوعی» سخن گفته شد.

زمانبندی این اتفاق، سورئال بود. دانشگاه ایالتی کالیفرنیا (CSU) درست همزمان با پیشنهاد کاهش ۳۷۵ میلیون دلار از بودجه خود، از ژست بزرگ فناوری خود رونمایی کرد. در حالی که مدیران، طرح ابتکاری هوش مصنوعی خود را رونمایی میکردند، همزمان در حال کاهش موقعیتهای هیئت علمی، کل برنامههای دانشگاهی و خدمات دانشجویی نیز بودند. در دانشگاه ایالتی کالیفرنیا، دو بار در عرض یک سال، اطلاعیههای اخراج عمومی صادر شد که بخشهایی مانند مطالعات عمومی و زبانهای مدرن را تحت تأثیر قرار داد. دانشگاه ایالتی سونوما، که محل تحصیل من بود، با کسری بودجه ۲۴ میلیون دلاری مواجه شد و اعلام کرد که قصد دارد ۲۳ برنامه دانشگاهی از جمله فلسفه، اقتصاد و فیزیک را حذف کند و بیش از ۱۳۰ موقعیت هیئت علمی، یعنی بیش از یک چهارم کادر آموزشی خود را تعدیل کند.

در دانشگاه ایالتی سانفرانسیسکو، دفتر رئیس دانشگاه رسما انجمن هیئت علمی کالیفرنیا (CFA) را از اخراجهای احتمالی مطلع کرد. اطلاعیهای که باعث ایجاد شوک در دانشگاه شد، زیرا اعضای هیئت علمی سعی کردند کاهش بودجه را با اشتیاق دولت به هوش مصنوعی تطبیق دهند. طنز ماجرا را نمیتوان نادیده گرفت: در همان ماهی که اتحادیه ما تهدید به اخراج دریافت کرد، مبلغان آموزشی اوپن ایآی در کتابخانه دانشگاه برای جذب اعضای هیئت علمی به سمت آموزش خودکار، فعالیت خود را آغاز کردند.

دانشگاه ایالتی کالیفرنیا (CSU) در آموزش سرمایهگذاری نمیکند بلکه آن را برونسپاری میکند و برای یک چتبات که بسیاری از دانشجویان از قبل به صورت رایگان از آن استفاده میکردند، قیمتهای بالایی میپردازد.

آموزش انتقادی به حراج گذاشته شد

آموزش عمومی دهههاست که به حراج گذاشته شده است. هنری ژیرو، نظریهپرداز فرهنگی، از اولین کسانی بود که مشاهده کرد چگونه دانشگاههای دولتی به عنوان تغذیهکنندههای حرفهای برای بازارهای خصوصی بازسازی میشوند. اکنون بخشهای دانشگاهی باید خود را با زبان درآمد، «دستاوردها» و «نتایج یادگیری» توجیه کنند. همکاری جدید دانشگاه ایالتی کالیفرنیا با اوپن ایآی آخرین چرخش این پیچ است.

دیگران نیز همین روند را دنبال کردهاند. شیلا اسلاتر و گری رودز آن را سرمایهداری دانشگاهی نامیدند: دانش به عنوان کالا و دانشجویان به عنوان مصرفکننده. کریستوفر نیوفیلد در کتاب «Unmaking the Public University» نشان داد که چگونه خصوصیسازی در واقع دانشگاههای دولتی را فقیر میکند و آنها را به پوستههایی از خودشان تبدیل میکند که با بدهی تأمین مالی میشوند.

بنجامین گینزبرگ ظهور «محوطه تماما اداری» را شرح داد، جایی که لایههای مدیریتی و فساد اداری حتی با کاهش اعضای هیئت علمی نیز افزایش یافت. و مارتا نوسباوم هشدار داد که وقتی علوم انسانی در یک دموکراسی به عنوان چیزهای بیارزش تلقی شوند، چه چیزی از دست میرود. این دو با هم دانشگاهی را توصیف میکنند که دیگر نمیپرسد آموزش برای چیست، بلکه فقط میپرسد چه چیزی میتواند به دست آورد.

سیستم دانشگاه ایالتی کالیفرنیا اکنون فصل بعدی آن داستان را نوشته است. مدیران در مواجهه با کسری بودجه و کاهش ثبتنام، شعار نوآوری هوش مصنوعی را چنان پذیرفتند که گویی رستگاری است. وقتی میلدرد گارسیا، رئیس دانشگاه ایالتی کالیفرنیا، همکاری ۱۷ میلیون دلاری با اوپن ایآی را اعلام کرد، بیانیه مطبوعاتی نوید یک «ابتکار عمل بسیار مشارکتی دولتی-خصوصی» را داد که «تجربه آموزشی دانشجویان را ارتقا میدهد» و «اقتصاد مبتنی بر هوش مصنوعی کالیفرنیا را به پیش میبرد». این بیانیه مطبوعاتی مانند یک بیانیه مطبوعاتی است که چت جیپیتی میتوانست بنویسد.

در همین حال، در دانشگاه ایالتی سانفرانسیسکو، تمام برنامههای تحصیلات تکمیلی اختصاص داده شده به تحقیقات انتقادی از جمله مطالعات زنان و جنسیت و انسانشناسی، به دلیل کمبود بودجه به حالت تعلیق درآمدند. اما جای نگرانی نیست: همه مجوز ChatGPT Edu رایگان دریافت کردند!

پروفسور مارتا کنی، رئیس دپارتمان مطالعات زنان و جنسیت و محقق اصلی کمک هزینه بنیاد ملی علوم که تأثیرات عدالت اجتماعی هوش مصنوعی را بررسی میکند، این تناقض را از نزدیک مشاهده کرد. اندکی پس از اعلام دانشگاه کالیفرنیا، او به همراه استاد انسانشناسی مارتا لینکلن، سرمقالهای در سانفرانسیسکو کرونیکل نوشت و هشدار داد که این ابتکار جدید خطر فریب دادن دانشجویان و تضعیف تفکر انتقادی را به همراه دارد.

کنی نوشت: ما باید سوالات انتقادی در مورد آنچه هوش مصنوعی با آموزش، کار و دموکراسی انجام میدهد، بپرسیم. سوالاتی که دپارتمان من به طور منحصر به فردی صلاحیت بررسی آنها را دارد.

طنز ماجرا از این هم تلختر بود: بودجه برنامههایی که به بهترین شکل ممکن برای مطالعهی پیامدهای اجتماعی و اخلاقی هوش مصنوعی تجهیز شده بودند، قطع میشد، در حالی که دانشگاه استفاده از محصولات اوپن ایآی را در سراسر محوطهی دانشگاه ترویج میداد.

در داخل موسسه، اصطلاحات شرکتی از طریق یادداشتهای اداری و ایمیلهای تحقیرآمیز به گوش میرسد. مدیران تحت پوشش «پایداری مالی» که روشی دوستانهتری برای گفتن «کاهشها» است، چاقوهای جراحی خود را تیز میکنند تا دانشگاه را مطابق با معیارهای بهرهوری به جای اهداف آموزشی، بازسازی کنند.

تکنوپولی (سلطه فناوری) به دانشگاه میآید

وقتی همکارانم در دانشکده بازرگانی اصرار دارند که چت جیپیتی فقط یک ابزار دیگر در جعبه ابزار است، وسوسه میشوم به آنها یادآوری کنم که فیسبوک زمانی فقط راهی برای ارتباط با دوستان بود. اما بین ابزارها و فناوریها تفاوت وجود دارد. ابزارها به ما کمک میکنند تا وظایف را انجام دهیم؛ فناوریها محیطهایی را که در آنها فکر، کار و ارتباط برقرار میکنیم، تغییر شکل میدهند. همانطور که فیلسوف پیتر هرشاک میگوید، ما صرفا از فناوریها استفاده نمیکنیم؛ ما در آنها مشارکت داریم. با ابزارها، ما عاملیت را حفظ میکنیم و میتوانیم انتخاب کنیم که چه زمانی و چگونه از آنها استفاده کنیم. با فناوریها، انتخاب ظریفتر است: آنها خود شرایط انتخاب را بازسازی میکنند. یک قلم، ارتباطات را بدون تعریف مجدد آن گسترش میدهد؛ رسانههای اجتماعی آنچه را که ما از حریم خصوصی، دوستی و حتی حقیقت میخواهیم، دگرگون میکنند.

نیل پستمن، نظریهپرداز رسانه، هشدار داد که سلطه فناوری زمانی ایجاد میشود که جوامع قضاوت را تسلیم الزامات فناوری میکنند. زمانی که کارایی و نوآوری به خودی خود به کالاهای اخلاقی تبدیل میشوند. هنگامی که معیارهایی مانند سرعت و بهینهسازی جایگزین تأمل و گفتگو میشوند، آموزش به لجستیک تبدیل میشود: نمرهدهی خودکار میشود، مقالهها در عرض چند ثانیه تولید میشوند. دانش به داده تبدیل میشود؛ آموزش به ارائه تبدیل میشود. آنچه ناپدید میشود، ظرفیتهای ارزشمند انسانی از جمله کنجکاوی، تشخیص و حضور است. نتیجه هوش افزوده نیست، بلکه یادگیری شبیهسازی شده است.

لانگدون وینر، نظریهپرداز سیاسی، زمانی پرسید که آیا مصنوعات میتوانند سیاست داشته باشند. آنها میتوانند و سیستمهای هوش مصنوعی نیز از این قاعده مستثنی نیستند. آنها فرضیاتی را در مورد آنچه هوش محسوب میشود و کار چه کسی ارزشمند است، رمزگذاری میکنند. هرچه بیشتر به الگوریتمها تکیه کنیم، ارزشهای آنها را بیشتر عادیسازی میکنیم.

امروزه در کلاسهای درس، تکنوپولی در حال رونق گرفتن است. دانشگاهها به عنوان مراکز تحقق راحتی شناختی بازسازی میشوند. به دانشجویان آموزش داده نمیشود که عمیقتر فکر کنند، بلکه آموزش داده میشود که مؤثرتر عمل کنند. ما در حال صادرات خودِ کار تدریس و یادگیری هستیم. آموزش انتقادی منسوخ شده است؛ ترفندهای بهرهوری جایگزین شدهاند. آنچه به عنوان نوآوری فروخته میشود، در واقع تسلیم شدن است. همانطور که دانشگاه ماموریت آموزشی خود را با «ادغام هوش مصنوعی و فناوری» معامله میکند، نه تنها خطر بیربط بودن را به جان میخرد بلکه خطر بیروح شدن مکانیکی را نیز به جان میخرد.

مجموعه فناوری تقلب-هوش مصنوعی

قبل از ورود هوش مصنوعی، من با همکارانم در مورد سرقت ادبی شوخی میکردم و میگفتم کاش یک اپلیکیشن هوش مصنوعی وجود داشت که بتواند برایمان این مقالههای سرقتی آنها را نمرهدهی کند. نیمهشوخی، نیمهجدی.

دانشجوها همیشه راههایی برای تقلب پیدا کردهاند از نوشتن جوابها روی کف دستشان گرفته تا استخدام نویسندهٔ سایه اما چت جیپیتی این موضوع را به مرحلهای کاملا جدید برد.

ناگهان آنها به یک دستیار نوشتاری دسترسی داشتند که نه میخوابید، نه پول میگرفت و نه هرگز «نه» میگفت.

دانشگاهها برای مقابله با این موضوع با شناسگرهای هوش مصنوعی به تکاپو افتادند با وجود نرخ بالای مثبت کاذب، سوگیریهای مستند علیه دانشجویانی که انگلیسی زبان اول آنها نیست و سیاهپوستان، و مسخره بودن جنگیدن با رباتها توسط رباتها. دانشگاهها با شرکتهای هوش مصنوعی شریک میشوند؛ دانشجوها از هوش مصنوعی برای تقلب استفاده میکنند؛ مدارس از تقلب وحشت میکنند و سپس با شرکتهای بیشتری برای شناسایی تقلب همکاری میکنند. این ملاقات سرمایهداری نظارتی با سوءعملکرد نهادی است، با دانشجویانی که در یک مسابقهٔ تسلیحاتی گرفتار شدهاند که هرگز نخواستند در آن شرکت کنند.

چونگین «روی» لی به عنوان دانشجوی سال اول دانشگاه کلمبیا با جاهطلبی وارد شد و یک تب اوپنایآی همیشه در سیستم او باز بود. طبق اعتراف خودش، او تقریبا در هر تکلیفی تقلب میکرد. او به مجله نیویورک گفت: من فقط سوال را در چت جیپیتی وارد میکردمم و هر ارائه میکرد را تحویل میدادم. هوش مصنوعی ۸۰ درصد از هر مقالهای را که تحویل میدادم، مینوشت. وقتی از او پرسیده شد که چرا اصلا زحمت درخواست دادن برای یک دانشگاه آیوی لیگ را به خود داده است، لی به طرز خلع سلاحکنندهای صادق بود: برای پیدا کردن یک همسر و یک شریک استارتاپی.

اولین سرمایهگذاری لی یک برنامه هوش مصنوعی به نام Interview Coder بود که برای تقلب در مصاحبههای شغلی آمازون طراحی شده بود. او از خودش در حال استفاده از آن فیلم گرفت؛ پست ویدیویی او همهگیر شد. دانشگاه کلمبیا او را به دلیل «تبلیغ یک ابزار تقلب» به حالت تعلیق درآورد. از قضا، این درست زمانی اتفاق افتاد که دانشگاه مانند دانشگاه ایالتی کالیفرنیا از همکاری با اوپن ایای، همان شرکتی که نرمافزاری را که لی برای تقلب در دروس خود استفاده میکرد، پشتیبانی میکرد، خبر داد.

لی بدون هیچ نگرانی، جلسه رسیدگی انضباطی خود را به صورت آنلاین منتشر کرد و دنبالکنندگان بیشتری به دست آورد. او و شریک تجاریاش، نیل شانموگان، استدلال کردند که اپلیکیشن آنها هیچ قانونی را نقض نکرده است. شانموگان به خبرگزاریها گفت: من در کلاسهای دانشگاه کلمبیا حتی یک چیز هم یاد نگرفتم. و فکر میکنم این موضوع در مورد اکثر دوستانم هم صدق میکند.

پس از تعلیقشان، این دو نفر ترک تحصیل کردند، ۵.۳ میلیون دلار بودجه اولیه جمعآوری کردند و به سانفرانسیسکو نقل مکان کردند.

شرکت جدیدشان؟ Cluely بود ماموریتش: ما میخواهیم در همه چیز تقلب کنیم. برای کمک به شما در تقلب هوشمندانهتر. شعارش: ما Cluely را ساختیم تا دیگر هرگز مجبور نباشید به تنهایی فکر کنید. Cluely هدفش را پنهان نمیکند؛ بلکه آن را به رخ میکشد.

برخی از موسسات به سادگی تسلیم شدهاند. دانشگاه ایالتی اوهایو اعلام کرد که استفاده از هوش مصنوعی دیگر به عنوان نقض صداقت تحصیلی محسوب نمیشود.

نیویورک تایمز در مورد الا استیپلتون، دانشجوی سال آخر دانشگاه نورث ایسترن، گزارش داد که متوجه شده استاد بازرگانیاش بیسروصدا از چت جیپیتی برای تولید اسلایدهای سخنرانی استفاده کرده است در حالی که برنامه درسی صراحتا دانشجویان را از انجام این کار منع کرده بود.

او که خشمگین شده بود، شکایتی را تنظیم کرد و خواستار بازپرداخت ۸۰۰۰ دلار، سهم خود از شهریه آن ترم، شد. دکتر ریک آروود، استاد، اعتراف کرد که از چت جیپیتی برای اسلایدهایش استفاده کرده تا «به آنها ظاهری تازه بدهد».

همه این تظاهرها، یک شوخی قدیمی شوروی را به ذهن متبادر میکند: آنها وانمود میکنند که به ما پول میدهند و ما وانمود میکنیم که کار میکنیم. در این مورد اساتید میگویند که آنها وانمود میکنند که از ما حمایت میکنند و ما وانمود میکنیم که آموزش میدهیم. و دانشجویان پاسخ میدهند: آنها وانمود میکنند که ما را آموزش میدهند و ما وانمود میکنیم که یاد میگیریم.

از مشاغل مزخرف تا مدارک مزخرف

دیوید گریبر، انسانشناس، در مورد ظهور «مشاغل مزخرف» نوشته است که کارهایی هستند که نه بر اساس ضرورت یا معنا، بلکه بر اساس اینرسی نهادی پشتیبانی میشوند. دانشگاهها اکنون در معرض خطر ایجاد دوقلوی دانشگاهی خود هستند: مدارک مزخرف. هوش مصنوعی تهدید میکند که هنر فعالیت بیمعنی را حرفهای کند و شکاف بین مأموریت عمومی آموزش و روالهای توخالی آن را گسترش دهد.

دانشگاهها پیش از این در این چرخه گرفتار شدهاند: دانشجویانی که کارهایی را انجام میدهند که میدانند پوچ است، اساتیدی که کارهایی را نمره میدهند که شک دارند خود دانشجویان نوشته باشند، و مدیرانی که «نوآوریها» را جشن میگیرند در حالی که همهٔ میدانند این نوآوریها در حال نابود کردن آموزشاند. تفاوت این وضعیت با «شغلهای پوشالی» در دنیای شرکتی این است که دانشجویان باید برای امتیاز شرکت در این نمایشِ آموزشِ صوری، پول هم بپردازند.

اگر چت جیپیتی بتواند مقالات دانشجویی را تولید کند، تکالیف را کامل کند و حتی بازخورد بدهد، بخش اعظم «معامله آموزشی» چه میشود؟ ما در خطر ایجاد سیستمی هستیم که در آن:

- دانشجویان شهریه میپردازند برای مدارکی که از طریق یادگیری واقعی کسب نکردهاند

- اساتید به کارهایی نمره میدهند که میدانند توسط خود دانشجویان تولید نشدهاند

- مدیران «افزایش کارایی» را جشن میگیرند در حالی که این در واقع کاهش یادگیری است

- کارفرمایان فارغالتحصیلانی را دریافت میکنند که مدارکشان چیزی دربارهٔ شایستگی واقعیشان نمیگوید

پیام واضح است. بگذارید چت جیپیتی کلاس شما را دوباره طراحی کند. بگذارید چت جیپیتی به شما بگوید چگونه دانشآموزان خود را ارزیابی کنید. بگذارید چت جیپیتی به دانشآموزان بگوید چگونه از چت جیپیتی استفاده کنند. بگذارید چت جیپیتی مشکل آموزش انسانی را حل کند.

سیا راج پوروهیت، یکی از کارکنان اوپن ایآی چیزی را که نقطه عطف شخصی مینامید، به اشتراک گذاشته است: لحظهای بود که من و چت جیپیتی با هم دوست شدیم. من روی یک پروژه کار میکردم و گفتم: هی، یادت هست ماه گذشته آن چیز را برای مدیرم ساختیم؟ و آن گفت: بله، سیا، یادم هست. آن لحظه بسیار قدرتمندی بود. احساس میکردم دوستی است که داستان من را به یاد میآورد و به من کمک میکند تا یک کارمند بهتر باشم.

یکی از اعضای هیئت علمی حرفش را قطع کرد. ببخشید… این یک ابزار است، درست است؟ منظورتان این است که یک ابزار قرار است دوست باشد؟

سیا حرفش را عوض کرد: خب، این حکایتی است که گاهی به اعضای هیئت علمی کمک میکند. مسئله فقط این است که چقدر از زمینهها را به خاطر میسپارد.

استاد پافشاری کرد: پس ما دانشجویان را تشویق میکنیم که با آن رابطه داشته باشند؟

سیا با دادههای نظرسنجی، که شعار هر مبلغ خوب فناوری آموزشی است، پاسخ داد: طبق نظرسنجی که ما انجام میدهیم، بسیاری از دانشجویان همین الان هم این کار را میکنند. آنها آن را به عنوان یک مربی، راهنما، راهنمای شغلی میبینند. این به خودشان بستگی دارد که چه نوع رابطهای میخواهند.

به دنیای جدید و شجاعانهی پیوند ماشینی فرااجتماعی خوش آمدید که توسط مرکز تعالی تدریس دانشگاه حمایت میشود. لحظهای پوچ اما آموزنده بود؛ دانشگاه در برابر آموزش مزخرف مقاومت نمیکرد، بلکه آن را به کار میگرفت. آموزش در بهترین حالت خود کنجکاوی و تفکر انتقادی را برمیانگیزد. «آموزش مزخرف» برعکس عمل میکند: مردم را طوری تربیت میکند که بیمعنایی را تحمل کنند، خودکار شدن تفکر خود را بپذیرند، و برای مدارک تحصیلی بیش از شایستگی ارزش قائل شوند.

اگر چت جیپیتی میتواند مقاله بنویسد، در امتحانات عالی رتبه بگیرد و معلم خصوصی بگیرد، دانشگاه دقیقا چه چیزی میفروشد؟ چرا دهها هزار دلار برای تجربهای که به طور فزایندهای خودکار میشود، بپردازید؟ چرا زندگی خود را وقف تدریس کنید؟ چرا اساتید دائمی را که نقششان عجیب، قرون وسطایی و زائد به نظر میرسد، حفظ کنید؟ اصلا چرا دانشگاهها وجود دارند؟

دانشجویان و والدین مطمئنا متوجه این پوسیدگی شدهاند. نرخ ثبتنام و حفظ دانشجو، به ویژه در سیستمهای دولتی در حال کاهش است. دانشجویان به درستی استدلال میکنند که پذیرفتن بدهیهای کمرشکن برای مدرکهایی که ممکن است به زودی منسوخ شوند، منطقی نیست.

کسانی که دههها صرف تقویت مهارت خود کردهاند، اکنون شاهدند که کار زندگیشان به راهاندازی یک چتبات تقلیل یافته است. جای تعجب نیست که بسیاری از آنها مزایای بازنشستگی را بین ساعات اداری محاسبه میکنند.

بگذارید هوش مصنوعی را به کار گیرند

من در وبینار آموزشی اوپن ایآی با عنوان «نوشتن در عصر هوش مصنوعی» شرکت کردم. این رویداد توسط سیا راج پوروهیت از اوپن ایآی برگزار شد که ماهها قبل در محوطه دانشگاه ایالتی سانفرانسیسکو دیده بودم. او قبل از معرفی جی دیکسیت، استاد سابق زبان انگلیسی دانشگاه ییل که به مبلغ هوش مصنوعی تبدیل شده و اکنون رئیس انجمن نویسندگان اوپن ایآی است، سخنان خود را با ستایش فراوان از مربیانی که «با همدلی و کنجکاوی با لحظه روبرو میشوند» آغاز کرد. وبسایت شخصی دیکسیت مانند فهرستی استادانه از فتوحات چت جیپیتی است.

در اینجا دیکسیت، محصول یک آموزش عالی ۸۰ هزار دلاری در سال در دانشگاه ییل، برای اساتید دانشگاههای دولتی مانند دانشگاه ایالتی سانفرانسیسکو سخنرانی میکرد که چگونه دانشجویان طبقه کارگر باید چت جیپیتی را بپذیرند. در دانشگاه ایالتی سانفرانسیسکو، ۶۰ درصد از دانشجویان، دانشجویان نسل اول دانشگاه هستند؛ بسیاری از آنها چندین شغل دارند یا از خانوادههای مهاجری هستند که در آنها آموزش، تنها شانس خانواده برای پیشرفت است. اینها دانشجویانی نیستند که بتوانند آینده تحصیلی خود را آزمایش کنند.

او توصیه کرد که اساتید نباید استفاده دانشجویان از چت جیپیتی را کنترل کنند، بلکه باید آنها را تشویق کنند تا «اخلاق هوش مصنوعی شخصی» خود را بسازند.

من سوالم را اینگونه مطرح کردم: چگونه میتوانیم انتظار داشته باشیم که به دانشجویان انگیزه بدهیم وقتی هوش مصنوعی میتواند به راحتی مقالههای آنها را تولید کند؟ به خصوص وقتی کمکهای مالی، بورسیهها و ویزاهای آنها همگی به معدل بستگی دارند؟ وقتی آموزش به یک فرآیند مرتبسازی تراکنشی و پرخطر برای یک بازار کار فوقالعاده رقابتی تبدیل شده است، چگونه میتوانیم انتظار داشته باشیم که آنها از هوش مصنوعی برای انجام کار خود استفاده نکنند؟

این متن هرگز با صدای بلند خوانده نشد. سیا از آن صرف نظر کرد و سوالاتی را ترجیح داد که امکان تشویق اخلاقی نرم را فراهم میکرد.

دانشجویان طبقه کارگر از درون فریبکاریها باخبرند

آنچه تبلیغ شرکتی دیکسیت کاملا از آن غافل بود این است که خود دانشجویان رهبری مقاومت را بر عهده دارند. در حالی که تیترهای خبری بر تقلب گسترده هوش مصنوعی متمرکز هستند، داستان متفاوتی در کلاسهای درس در حال ظهور است که در آن اساتید واقعا به دانشجویان خود گوش میدهند.

در دانشگاه ایالتی سانفرانسیسکو، پروفسور مارتا کنی، که ریاست بخش مطالعات زنان و جنسیت را بر عهده داشت، آنچه را که پس از اعلام همکاری دانشگاه و اوپن ایآی در کلاس علمی خود اتفاق افتاد، توصیف کرد. کنی به من گفت، دانشجویانش «به درستی شک داشتند که استفاده منظم از هوش مصنوعی مولد در کلاس درس، آنها را از آموزشی که برای آن هزینه زیادی پرداخت میکنند، محروم کند». اکثر آنها تا پایان ترم ChatGPT Edu را باز نکرده بودند. همکار او، مارتا لینکلن، که انسانشناسی تدریس میکند، شاهد همین شک و تردید بود.

اینها دانشجویان ممتاز آیوی لیگ نبودند که به دنبال میانبر باشند. اینها دانشجویان نسل اول دانشگاه بودند، بسیاری از آنها از گروههای به حاشیه رانده شده تاریخی، که چیزی را میفهمیدند که ظاهرا مدیران نمیدانستند: از آنها خواسته میشد برای یک محصول ارزانتر، قیمتهای بالایی بپردازند.

کنی توضیح داد که چت جیپیتی یک فناوری آموزشی نیست. برای آموزش طراحی یا بهینه نشده است.

علی کاشانی، مدرس دپارتمان علوم سیاسی و عضو کمیته مقالهنویسی جمعی اتحادیه اعضای هیئت علمی درباره هوش مصنوعی، نگرانی مشابهی را بیان کرد. دانشگاه ایالتی کالیفرنیا بدون انجام هیچ تحقیق درستی درباره اثرات آن، هوش مصنوعی را بر اساتید و دانشجویان تحمیل کرد.

دانشجویان نسل اول و دانشجویان محروم، تجربه جنبه منفی هوش مصنوعی را خواهند داشت. دانشجویان به عنوان خوکچههای آزمایشگاهی در آزمایشگاه هوش مصنوعی استفاده میشوند. این عبارت یعنی خوکچههای آزمایشگاهی بازتاب هشدار کنی و لینکلن در مقاله آنهاست که نوشتند: معرفی هوش مصنوعی در آموزش عالی اساسا یک آزمایش بدون مقررات است. چرا دانشجویان ما باید خوکچههای آزمایشگاهی باشند؟

برای کاشانی و دیگران، سوال این نیست که آیا آموزگاران طرفدار یا مخالف فناوری هستند؛ بلکه این است که چه کسی آن را کنترل میکند و با چه هدفی. هوش مصنوعی آموزش را دموکراتیک نمیکند؛ بلکه آن را خودکار میسازد.

دکتر صفیه نوبل نویسنده کتاب «الگوریتمهای ظلم» از اساتید خواست تا شفافیت درباره نحوه ذخیره دادهها، بهرهکشی نیروی کار پشت سیستمهای هوش مصنوعی و آسیبهای زیستمحیطی که سیستم دانشگاه ایالتی کالیفرنیا در آن سهیم است را مطالبه کنند.

مقاومت فراتر از کالیفرنیا در حال گسترش است. اساتید دانشگاههای هلند نامهٔ سرگشادهای صادر کردهاند و خواستار توقف موقت استفاده از هوش مصنوعی در محیطهای دانشگاهی شدهاند و هشدار دادهاند که استفاده از آن «تفکر انتقادی را مهارتزدایی میکند» و دانشجویان را به اپراتورهای ماشین تبدیل میکند.

کنی توضیح داد: بسیاری از دانشجویان رشته زنان و مطالعات جنسیتی به دلایل ابزارگرایانه مدرک نمیگیرند. آنها آنجا هستند چون میخواهند تفکر انتقادی داشته باشند و شهروندان فعال سیاسی باشند. این دانشجویان چیزی را میفهمند که مدیران و مبلغین فناوری نمیفهمند: آنها برای خودکارسازی پول نمیدهند. آنها برای راهنمایی، گفتگو و روابط فکری که نمیتوان به یک چتبات واگذار کرد، پول میدهند.

استعمار جدید هوش مصنوعی

روح آموزش عمومی در خطر است. وقتی بزرگترین سیستم دانشگاه دولتی به یک چتبات هوش مصنوعی از شرکتی مجوز میدهد که روزنامهنگاران را در لیست سیاه قرار میدهد، از کارگران داده در جنوب جهان سوءاستفاده میکند، قدرت ژئوپلیتیکی و انرژی را در مقیاسی بیسابقه جمعآوری میکند و خود را به عنوان یک متولی غیرمنتخب سرنوشت بشر قرار میدهد، به ماموریت خود به عنوان دانشگاه مردم که ریشه در آرمانهای دموکراتیک و عدالت اجتماعی دارد، خیانت میکند. اوپن ایآی یک شریک نیست بلکه یک امپراتوری است.

من این روند را از دو دیدگاه تماشا کردهام: به عنوان یک استاد که آن را تجربه میکند، و به عنوان یک دانشجوی نسل اول که زمانی باور داشت دانشگاه مکانی مقدس برای یادگیری است. در دهه ۱۹۸۰، من در دانشگاه سونوما ایالت کالیفرنیا تحصیل میکردم. دانشگاه شهریهای دریافت نمیکرد و فقط یک هزینه ثبتنام ناچیز به مبلغ ۶۷۰ دلار در سال داشت. اقتصاد در رکود بود، اما من تقریبا متوجه نشدم. من از قبل ورشکسته بودم. اگر به چند دلار نیاز داشتم، صفحههای گرامافونم را در فروشگاه صفحات موسیقی دست دوم میفروختم. من به دانشگاه نمیرفتم «بهخاطر این که» شغل پیدا کنم. من رفتم تا کشف کنم، به چالش کشیده شوم و بفهمم چه چیزی اهمیت دارد. ۶ سال طول کشید تا با مدرک روانشناسی فارغالتحصیل شوم و این ۶ سال از با ارزشترین و جستجوگرانهترین سالهای زندگی من بود.

چنین نوعی از آموزش یعنی باز، مقرونبهصرفه و معناجو زمانی در دانشگاههای دولتی شکوفا بود. اما اکنون تقریبا منقرض شده است. این نوع آموزش «قابل توسعه» نیست. در طرح استراتژیک جای نمیگیرد. و قابل محاسبه نیست و به همین دلیل است که هوش مصنوعی میخواهد آن را حذف کند.

اما این همچنین یک حقیقت دیگر را نشان میدهد: اوضاع میتواند متفاوت باشد. زمانی متفاوت بوده است.

انتهای پیام